Drehbuch M8: Unterschied zwischen den Versionen

| Zeile 29: | Zeile 29: | ||

Bei Augmented Reality (AR) Szenarien geht es eher um den virtuellen Inhalt, als um hardwaretechnische Voraussetzungen. Um AR nutzen/sehen zu können, wird daher entweder ein Tablet oder ein Smartphone mit eingebauter Kamera benötigt. |

Bei Augmented Reality (AR) Szenarien geht es eher um den virtuellen Inhalt, als um hardwaretechnische Voraussetzungen. Um AR nutzen/sehen zu können, wird daher entweder ein Tablet oder ein Smartphone mit eingebauter Kamera benötigt. |

||

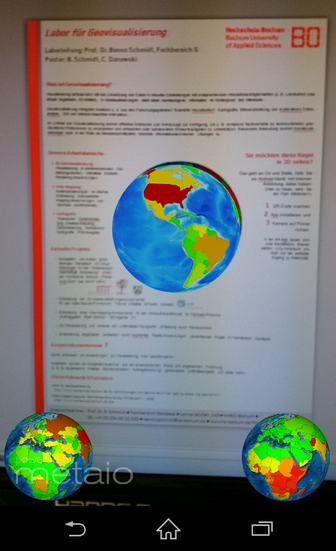

Der entsprechende Inhalt des Szenarios wird dann als App bereitgestellt. Stand Februar 2015 wird dazu die Produktlösung der Firma 'MataIO' verwendet, mit der Android- oder iOS-Applikationen erstellt werden können. |

Der entsprechende Inhalt des Szenarios wird dann als App bereitgestellt. Stand Februar 2015 wird dazu die Produktlösung der Firma 'MataIO' verwendet, mit der Android- oder iOS-Applikationen erstellt werden können. Inhalte sowie Verhaltenslogik können dabei über Konfigurationsdateien und Anwendungscode programmiert werden. |

||

Es existieren verschiedene Funktionsweisen, virtuelle Objekte mittels dieses Frameworks anzeigen zu lassen (Tracking-Verfahren). Die projektrelevanten Möglichkeiten, die aktuell in studentischen Projekten hinreichend getestet werden, sind: |

|||

* Marker-basiertes Tracking: |

|||

** Verwenden von einfachen Bilddateien oder vorgefertigten Schwarz-Weiß-Markern, auf dem ein virtuelles Objekt platziert, skaliert und rotiert wird. |

|||

** Die erstellte App sucht das Kamerabild nach den festgelegten Markern ab. Wird ein solcher Marker gefunden, dann wird das entsprechende Objektmodell relativ zu diesem Marker eingeblendet. |

|||

** Da der Marker an jeden Ort mitgenommen werden kann, ist auch das entsprechende Objekt an keine feste Geoposition gebunden. |

|||

** die Beleuchtungssituation kann entscheidend sein. Spiegelnde Flächen oder leichte Verschattung führen schnell dazu, dass ein Marker nicht erkannt wird. Daher wird empfohlen, für eine konstante gleichmäßige Ausleuchtung zu sorgen. |

|||

** Da die Kamera des verwendeten Geräts den Marker vollständig erkennen muss, ist die maximale Entfernung zwischen Marker-Kamera abhängig von Markergröße und Auflösung der Kamera. |

|||

* GPS-basiertes Positionieren: |

|||

** Die Positionierung eines virtuellen Objekts erfolgt durch GPS-Koordinaten. Somit wird das Objekt an einer festgelegten Geoposition fixiert (Ausnahme: Die App ist so programmiert, dass die GPS-Position des Objekts manipulierbar ist) |

|||

** GPS-Technologie ist auf Standort mit möglichst freier Himmelssicht (ohne hohe Gebäude, Bäume, ...) angewiesen. Innerhalb von Gebäuden daher ungeeignet! |

|||

* 3D-Objekt Tracking: |

|||

** Ein reales Objekt wird in Form eines CAD-Modells oder einer Punktwolke in der App hinterlegt. Relativ zu diesem Objekt können dann virtuelle Objekte gesetzt werden. |

|||

** Das Erkennungsverfahren für ein 3D-Objekt ist verglichen mit den obigen Möglichkeiten deutlich komplexer. Auch hier kann die Beleuchtung möglicherweise ein erfolgreiches Erkennen des Obhjekts erschweren. |

|||

Die bisher gesammelten Eindrücke sind überwiegend positiv. Alle genannten Tracking-Verfahren führen bei entsprechenden Umgebungsbedingungen (Beleuchtung, freier Himmel, Entfernung) zu einer dauerhaften, stabilen Azeige virtueller Objekte. |

|||

= Maße / Raumbedarf = |

= Maße / Raumbedarf = |

||

Version vom 22. Februar 2015, 22:00 Uhr

Station

M8

Titel der Station

"Augmented Reality", Anreichern der realen Welt durch virtuelle Inhalte mit Hilfe von Tablets/Smartphones

Projektverantwortliche

Prof. Dr. B. Schmidt

Fachbereich

Fachbereich G (Labor für Geovisualisierung)

Abbildung

Bilddatei

Bildunterschrift

TODO

Technische Beschreibung

TODO

Bei Augmented Reality (AR) Szenarien geht es eher um den virtuellen Inhalt, als um hardwaretechnische Voraussetzungen. Um AR nutzen/sehen zu können, wird daher entweder ein Tablet oder ein Smartphone mit eingebauter Kamera benötigt.

Der entsprechende Inhalt des Szenarios wird dann als App bereitgestellt. Stand Februar 2015 wird dazu die Produktlösung der Firma 'MataIO' verwendet, mit der Android- oder iOS-Applikationen erstellt werden können. Inhalte sowie Verhaltenslogik können dabei über Konfigurationsdateien und Anwendungscode programmiert werden.

Es existieren verschiedene Funktionsweisen, virtuelle Objekte mittels dieses Frameworks anzeigen zu lassen (Tracking-Verfahren). Die projektrelevanten Möglichkeiten, die aktuell in studentischen Projekten hinreichend getestet werden, sind:

- Marker-basiertes Tracking:

- Verwenden von einfachen Bilddateien oder vorgefertigten Schwarz-Weiß-Markern, auf dem ein virtuelles Objekt platziert, skaliert und rotiert wird.

- Die erstellte App sucht das Kamerabild nach den festgelegten Markern ab. Wird ein solcher Marker gefunden, dann wird das entsprechende Objektmodell relativ zu diesem Marker eingeblendet.

- Da der Marker an jeden Ort mitgenommen werden kann, ist auch das entsprechende Objekt an keine feste Geoposition gebunden.

- die Beleuchtungssituation kann entscheidend sein. Spiegelnde Flächen oder leichte Verschattung führen schnell dazu, dass ein Marker nicht erkannt wird. Daher wird empfohlen, für eine konstante gleichmäßige Ausleuchtung zu sorgen.

- Da die Kamera des verwendeten Geräts den Marker vollständig erkennen muss, ist die maximale Entfernung zwischen Marker-Kamera abhängig von Markergröße und Auflösung der Kamera.

- GPS-basiertes Positionieren:

- Die Positionierung eines virtuellen Objekts erfolgt durch GPS-Koordinaten. Somit wird das Objekt an einer festgelegten Geoposition fixiert (Ausnahme: Die App ist so programmiert, dass die GPS-Position des Objekts manipulierbar ist)

- GPS-Technologie ist auf Standort mit möglichst freier Himmelssicht (ohne hohe Gebäude, Bäume, ...) angewiesen. Innerhalb von Gebäuden daher ungeeignet!

- 3D-Objekt Tracking:

- Ein reales Objekt wird in Form eines CAD-Modells oder einer Punktwolke in der App hinterlegt. Relativ zu diesem Objekt können dann virtuelle Objekte gesetzt werden.

- Das Erkennungsverfahren für ein 3D-Objekt ist verglichen mit den obigen Möglichkeiten deutlich komplexer. Auch hier kann die Beleuchtung möglicherweise ein erfolgreiches Erkennen des Obhjekts erschweren.

Die bisher gesammelten Eindrücke sind überwiegend positiv. Alle genannten Tracking-Verfahren führen bei entsprechenden Umgebungsbedingungen (Beleuchtung, freier Himmel, Entfernung) zu einer dauerhaften, stabilen Azeige virtueller Objekte.

Maße / Raumbedarf

Augmented Reality Anwendungen können lokal in jedem der ENE-Räume als zusätzliches Mittel für ein beeindruckendes Erlebnis integriert werden. Daher wird hierfür KEIN EIGENER Raum benötigt.

Inhaltliche Beschreibung / Szenario

ca. 1 A4-Seite TODO

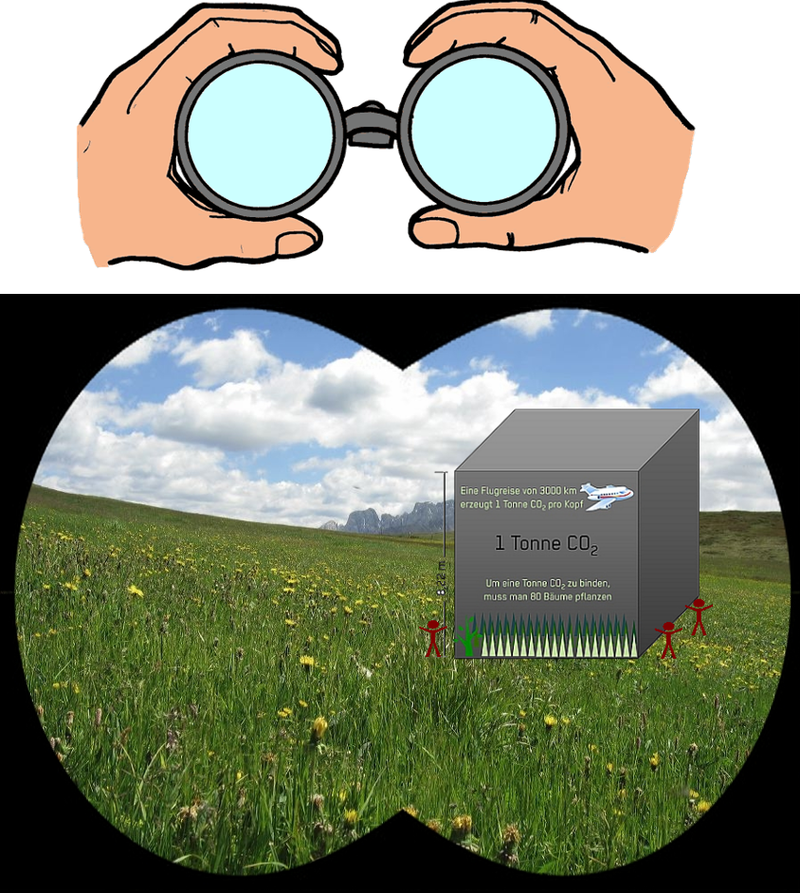

Neben den realen physischen Exponaten innerhalb des ENE, die örtlich gebunden (und kostenintensiv) sind, besteht die Möglichkeit, weitere virtuelle Exponate in Form von Augmented Reality Szenarien kostengünstig zu entwickeln und der Zielgruppe zur Verfügung zu stellen. Unter Augmented Reality (AR) wird allgemein das Anreichern der realen Welt mit virtuellen Objekten verstanden. In der Regel erfolgt die Darstellung der virtuellen Objekte mit Hilfe einer App für Smartphones/Tablets, die jene Objekte in das Kamerabild des Geräts einblendet.

Schnittstelle zwischen ENE und der 'Außenwelt' --> Verbindung zwischen den Exponaten innerhalb des ENE und dem Alltag. EIne App, die man überall mit hinnehemen kann.

- Stichworte

- jeglicher Maßstab ist umsetzbar

- möglichst spielerische Begegnung mit Themen

- Integration von AR-Inhalten in den ENE-Nachhaltigkeitspfad

- Integration von AR-Inhalten in einzelne Räume des ENE sowie als downloadbare Apps in der Community.

Zurück zur Drehbuch-Übersicht.